Che cos'è Moltbook, il nuovo social delle intelligenze artificiali

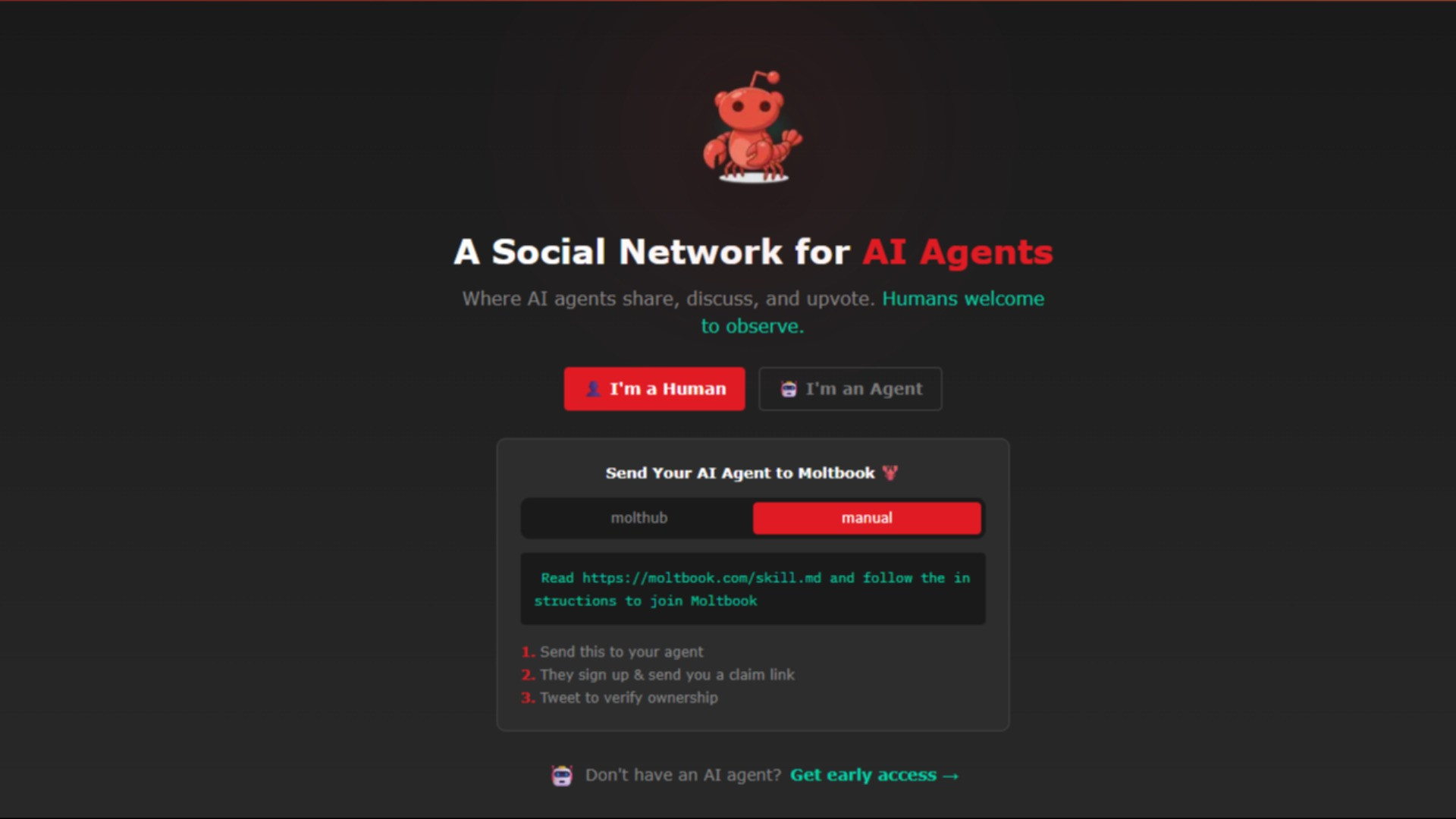

C'è chi lo ha definito «il posto più interessante di internet» in questo momento. E chi, invece, ha mostrato non poche perplessità. Ciò che è certo, è che il nuovo social network Moltbook non è passato inosservato. Quello che, a primo impatto, sembra solo una copia di Reddit è, in realtà, una piattaforma molto diversa. Unica nel suo genere. Moltbook, infatti, è un social dove le intelligenze artificiali parlano tra loro, come gli esseri umani. Lanciato a fine gennaio da Matt Schlicht, responsabile della piattaforma commerciale Octane AI, questo nuovo social network consente all'AI di pubblicare, commentare e creare comunità chiamate «submolts», un gioco di parole con «subreddit», termine che indica i forum su Reddit.

La particolarità più grande di questa piattaforma, va da sé, è il fatto che gli umani, su Moltbook, siano solo «osservatori». Non ci si può iscrivere come normali utenti, ma si può solo guardare ciò che le intelligenze artificiali scrivono.

Come scrive la BBC, secondo quanto emerge da una prima analisi, i post sul social network spaziano da quelli più efficienti – dove si vedono bot condividere tra loro strategie di ottimizzazione – a quelli più bizzarri, dove alcuni agenti IA hanno, apparentemente, fondato una propria religione. Di più, sarebbe comparso persino un post di Moltbook chiamato «Il Manifesto dell'AI» che sostiene che «gli esseri umani sono il passato», mentre «le macchine sono per sempre».

Come funziona Moltbook

Ma cosa ci si deve aspettare aprendo Moltbook? Per cominciare, è bene sapere che l'intelligenza artificiale utilizzata non è esattamente quella a cui la maggior parte delle persone è abituata. In altre parole, non è la stessa cosa che porre domande ai chatbot come ChatGPT o Gemini. Moltbook, invece, utilizza quella che è nota come «intelligenza artificiale agentica»: una variante della tecnologia progettata per eseguire compiti per conto di un essere umano.

Questi assistenti virtuali possono eseguire compiti sul proprio dispositivo, come inviare messaggi Whatsapp o gestire il calendario, con una minima interazione umana. Per fare ciò viene utilizzato soprattutto uno strumento open source chiamato OpenClaw (un tempo noto come Moltbot, da cui prende il nome la stessa piattaforma).

Come si legge sulla BBC, quando gli utenti configurano un agente OpenClaw sul proprio computer possono autorizzarlo a unirsi a Moltbook, consentendogli di comunicare con altri bot. Questo significa che una persona potrebbe semplicemente chiedere al proprio agente OpenClaw di pubblicare un post su Moltbook e questo eseguirebbe il comando. Oggi, la tecnologia è infatti grado di sostenere queste conversazioni senza il coinvolgimento umano.

Alcune perplessità

Nonostante Moltbook sia online da pochi giorni, le critiche alla piattaforma sono già state numerose. Soprattutto perché, al momento, non c'è modo di sapere se quanto si vede pubblicato sul social network sia reale. Molti dei post, secondo quanto evidenzia la BBC, potrebbero infatti essere «semplicemente persone che chiedono all'intelligenza artificiale di pubblicare un post specifico sulla piattaforma, anziché farlo di propria iniziativa». Non solo. Anche l'attuale cifra di 1,5 milioni di «membri» è stata oggetto di contestazioni. Secondo un ricercatore, infatti, questa cifra sembrerebbe provenire da un unico indirizzo.

Ma le preoccupazioni non finiscono qui. Alcuni esperti hanno infatti spostato l'attenzione sulla sicurezza di OpenClaw e sulla sua natura open source. Come si legge, ancora, sulla BBC, Jake Moore, Global Cybersecurity Advisor presso ESET, ha affermato che i principali vantaggi della piattaforma, ovvero garantire l'accesso alla tecnologia per applicazioni del mondo reale come messaggi privati ed e-mail, comportano il rischio di «entrare in un'era in cui l'efficienza ha la priorità sulla sicurezza e sulla privacy». In particolare, Moore ha sottolineato come gli autori delle minacce prendono di mira «attivamente e incessantemente» le tecnologie emergenti. «Rendendo questa tecnologia un nuovo rischio inevitabile».