Dall'ETH un chip per identificare i deepfake

L’avvento dell’intelligenza artificiale rende sempre più difficile distinguere immagini reali da quelle manipolate. Sui social non è raro imbattersi in video e contenuti apparentemente autentici che in realtà sono falsi. E un numero crescente di persone viene ingannato o mette in discussione anche informazioni provenienti da fonti credibili. Per contrastare il fenomeno dei cosiddetti deepfake, ricercatori dell’ETH di Zurigo hanno sviluppato una tecnologia in grado di certificare l’autenticità dei contenuti già al momento della loro acquisizione.

Come funziona la tecnologia

Come si legge in una nota del Politecnico federale, il sistema prevede che foto, video o segnali audio vengano firmati crittograficamente direttamente all’interno del chip del sensore nel momento esatto in cui vengono registrati. Questa firma consente di verificare che i dati provengano realmente da una determinata fotocamera o dispositivo di registrazione. Inoltre, indica quando sono stati acquisiti i dati e garantisce che non siano stati modificati successivamente. «Se i dati vengono firmati nel momento stesso della cattura, qualsiasi manipolazione successiva lascia tracce», spiega Fernando Cardes, ricercatore coinvolto nello sviluppo della tecnologia. «Per manipolare i dati, il chip dovrebbe essere "attaccato" fisicamente, il che richiederebbe uno sforzo tecnologico enorme, rendendo di fatto impossibile la produzione su larga scala di contenuti manipolati per le piattaforme social», aggiunge.

Un pubblico registro

Secondo i ricercatori le firme generate dal sensore potrebbero essere salvate in un registro pubblico, accessibile e immutabile, ad esempio basato su tecnologia blockchain. In questo modo chiunque potrebbe verificare in qualsiasi momento l’autenticità di un contenuto confrontando la firma del chip con i dati originali e confermandone la provenienza. «La fiducia nei contenuti digitali si sta erodendo. Volevamo creare una tecnologia che permetta alle persone di verificare se qualcosa è autentico», aggiunge Felix Franke, co-sviluppatore del chip e oggi professore all’Università di Basilea.

Come è nato il progetto

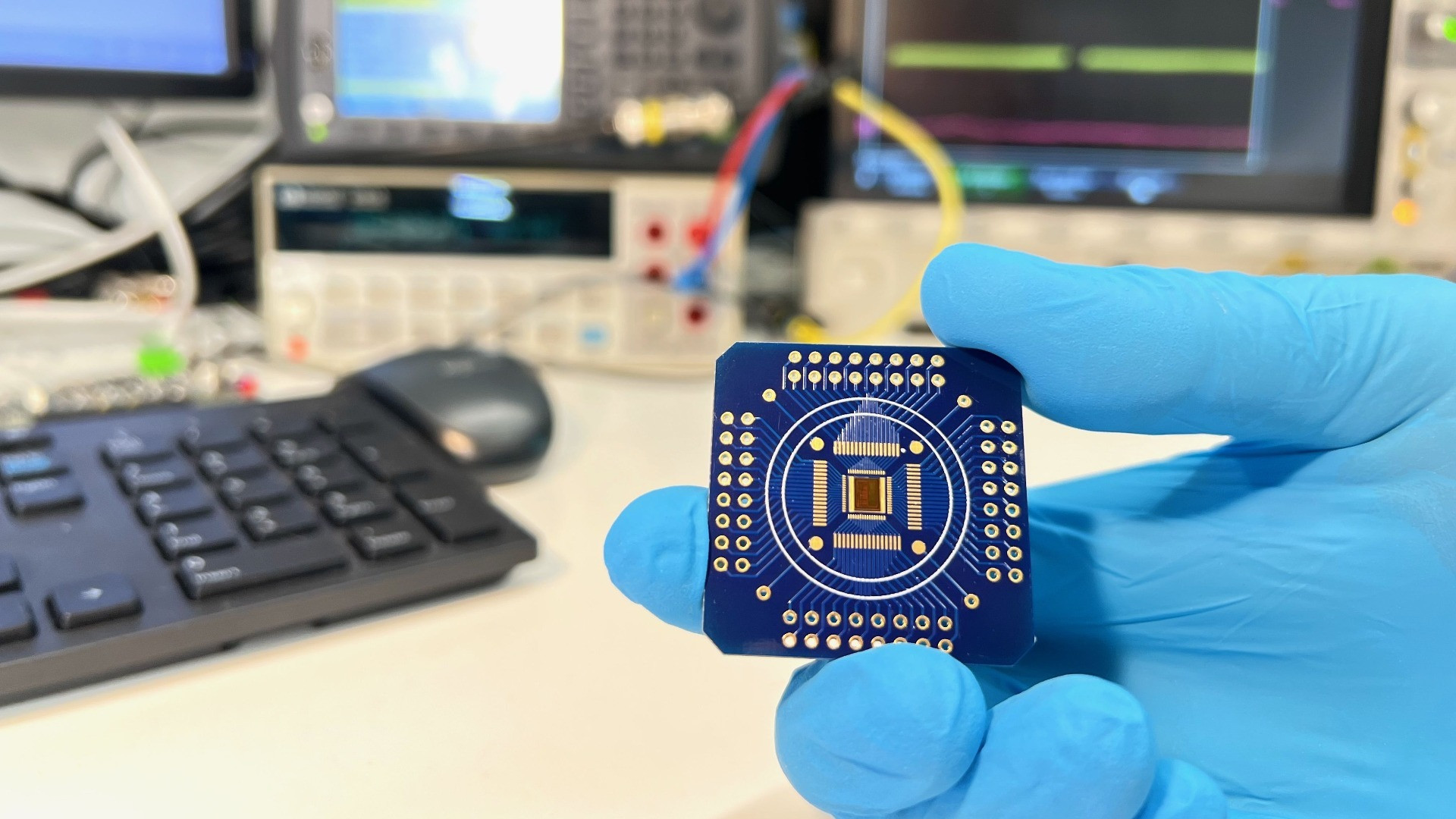

Il chip, descritto in uno studio pubblicato martedì 24 marzo su Nature, per ora è solo un prototipo che è stato concepito ben prima che i sistemi di intelligenza artificiale come ChatGPT diventassero oggetto di dibattito pubblico. L’idea è infatti nata come progetto parallelo presso il Bio Engineering Laboratoy del Politecnico zurighese, che lavorava già su sensori altamente sensibili per misurare segnali elettrici provenienti da cellule viventi. Il team interdisciplinare disponeva inoltre delle competenze necessarie per integrare direttamente nei chip funzioni crittografiche aggiuntive. Secondo Franke il pericolo rappresentato dai deepfake era già “prevedibile”. È per questo che, nel 2017, fu elaborato il piano di sviluppare un sensore i cui dati non potessero essere manipolati senza che ciò venisse rilevato.

Depositata una domanda di brevetto

Il dispositivo, come detto, non è ancora in commercializzazione e saranno necessari ulteriori passaggi. Ma i ricercatori sono fiduciosi che, con i processi attuali, la tecnologia potrà essere sviluppata fino a diventare un prodotto pronto per il mercato. A questo proposito i ricercatori hanno già depositato una domanda di brevetto. «Stiamo attualmente valutando come ridurre i costi per i produttori di fotocamere e sensori qualora decidessero di integrare la nuova tecnologia nei loro chip», riferisce Cardes.

Le possibili applicazioni della tecnologia

In linea di principio, la tecnologia potrebbe essere integrata in qualsiasi tipo di sensore o fotocamera. I ricercatori ipotizzano che in futuro anche le piattaforme social potrebbero verificare automaticamente l’autenticità dei contenuti al momento del caricamento. In alternativa, anche giornalisti, ricercatori o autorità pubbliche potrebbero effettuare controlli autonomamente attraverso strumenti semplici. Se sviluppato su larga scala, il sistema potrebbe quindi contribuire a contrastare la diffusione dei deepfake e a rafforzare la fiducia nei contenuti digitali, diventando uno strumento chiave nella lotta alla disinformazione.